15년차 임베디드 개발자가 읽어본 Arm의 공식 발표, 현실적으로 뜯어봤습니다.

이 글을 쓰게 된 이유

공장 라인에 카메라가 달려 있고, 로봇팔이 있고, 컨트롤러가 있어요.

지금까지 이것들은 따로따로 일했어요. 카메라는 찍어서 클라우드로 올리고, 클라우드가 판단하고, 그 결과를 로봇팔이 받아서 실행하는 구조였죠.

근데 이번 주, 그 구조가 바뀐다는 신호가 나왔어요.

Arm이 뭔 회사인지 모르시는 분들을 위해

여러분 손에 든 스마트폰, 공장 MCU, 자동차 ECU — 전부 Arm 설계가 들어가 있어요.

삼성, 애플, 퀄컴, TI, Infineon... 이 회사들이 만드는 칩의 90% 이상이 Arm 아키텍처 기반이에요. 반도체 설계 분야에서 사실상 표준을 쥐고 있는 회사예요.

그 Arm이 공식 발표를 낸 곳이 Arm Newsroom (newsroom.arm.com) 이에요. 언론사 기사가 아니라 Arm이 직접 쓴 공식 채널이라 신뢰도가 높아요.

Embedded World가 뭔데?

임베디드 업계의 CES라고 보면 돼요.

매년 독일 뉘른베르크에서 열리는 세계 최대 임베디드 시스템 전시회예요. TI, Infineon, NXP, Arm 같은 굵직한 반도체 회사들이 전부 모여서 그 해의 기술 방향을 발표하는 자리죠.

올해 2026년은 3월 10~12일에 열렸고, 핵심 키워드는 단연 Edge AI 였어요.

Arm의 핵심 메시지: "AI가 MCU 안으로 들어온다"

Arm이 이번 Embedded World에서 보여준 데모는 4가지예요. 전부 같은 방향을 가리키고 있어요.

"클라우드한테 묻지 말고, 현장 MCU가 직접 판단하자"

하나씩 쉽게 설명할게요.

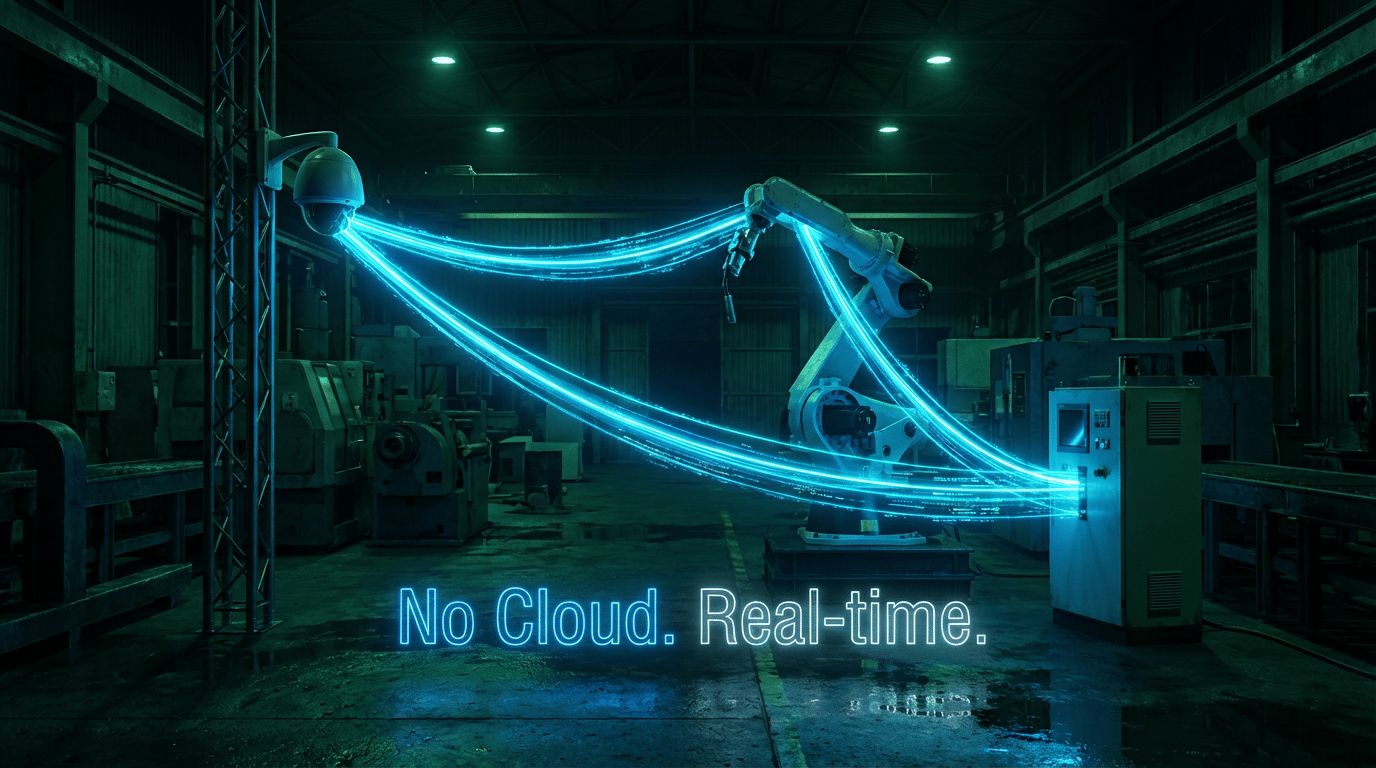

Demo 1 — 장비들이 서로 대화한다

카메라, 로봇팔, 컨트롤러가 중앙 서버 없이 서로를 인식하고 실시간으로 협력하는 데모예요.

기존에는 이랬어요:

카메라 → 클라우드 → 판단 → 로봇팔 실행

이제는 이래요:

카메라 MCU: "불량품 감지!" 로봇팔 MCU: "바로 멈출게" 컨트롤러 MCU: "라인 속도 줄일게"

클라우드 왕복 없이, 밀리초 단위로 현장에서 반응해요. 인터넷이 끊겨도 동작하고, 반응 속도도 훨씬 빠르죠.

Demo 2 — 클라우드 없이 "헤이 시리"

스마트 스피커의 음성 인식, 지금은 전부 클라우드로 올라가요. 근데 공장 장비나 자동차 부품은 전력 예산이 빡빡하고, 개인정보 문제도 있어요.

Arm은 이걸 NPU 가속으로 MCU 안에서만 처리하는 걸 보여줬어요.

NPU가 뭐냐고요? AI 연산만 전담으로 초고속 처리하는 전용 칩이에요. CPU가 "만능 일꾼"이라면, NPU는 "AI 계산만 죽어라 빠르게 하는 전담 직원"이에요.

이 덕분에 클라우드 모듈 없이도 음성 기능 탑재가 가능해졌어요.

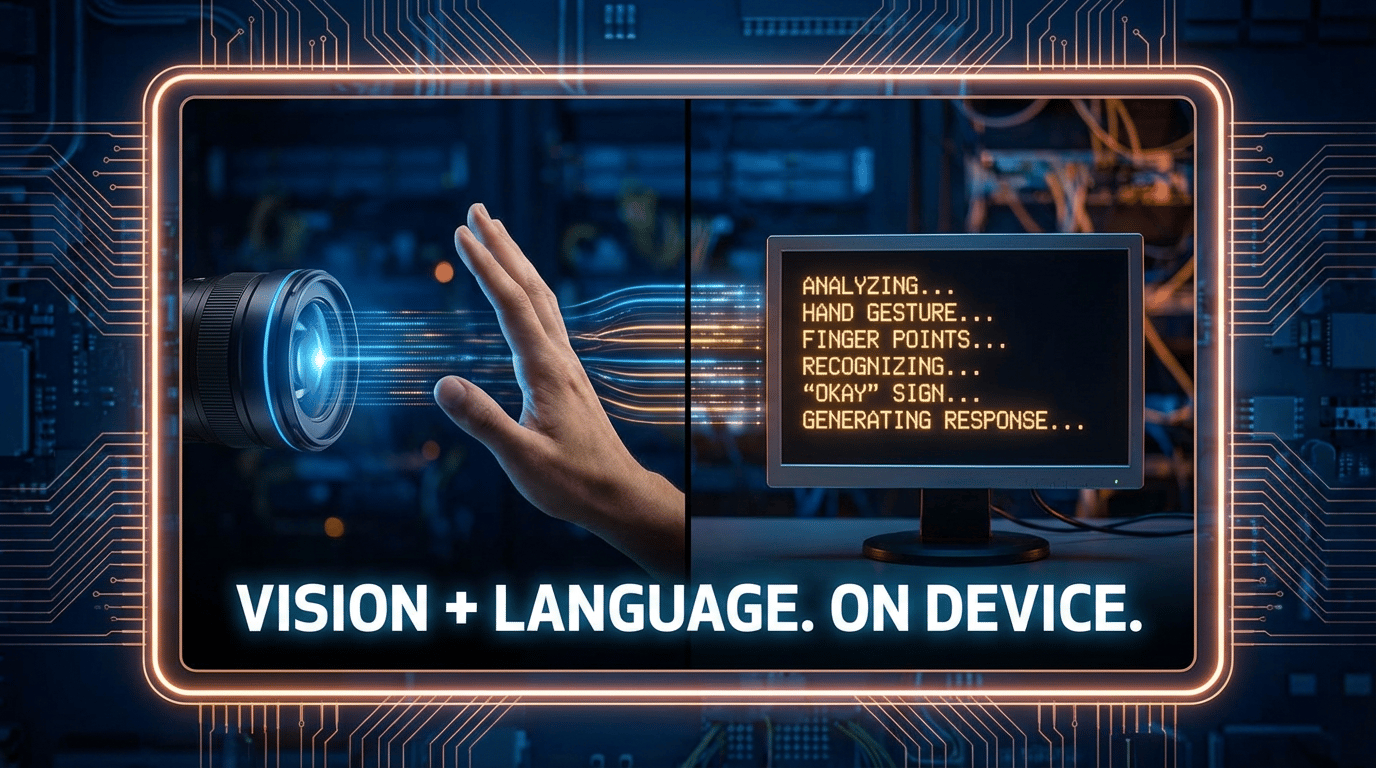

Demo 3 — 카메라 + LLM이 MCU 안에서

"멀티모달"이 어렵게 들리는데, 쉽게 말하면 눈(카메라) + 말(LLM)을 동시에 쓴다는 거예요.

카메라로 물건 찍으면 → MCU가 "이게 뭔지" 인식하고 → 거기에 맞는 텍스트까지 생성. 전부 로컬에서 처리해요.

의료 현장을 예로 들면, 수술 중 카메라가 환부를 보고 "출혈 감지, 혈압 주의" 같은 음성으로 알려주는 거예요. 이 영상이 클라우드로 올라가면 환자 개인정보 문제가 생기는데, MCU 안에서 처리하면 데이터가 밖으로 나가지 않아요.

자동차도 마찬가지예요. 운전자 얼굴을 찍어서 졸음 감지하는 카메라, 그 영상이 외부 서버로 올라가면 안 되잖아요.

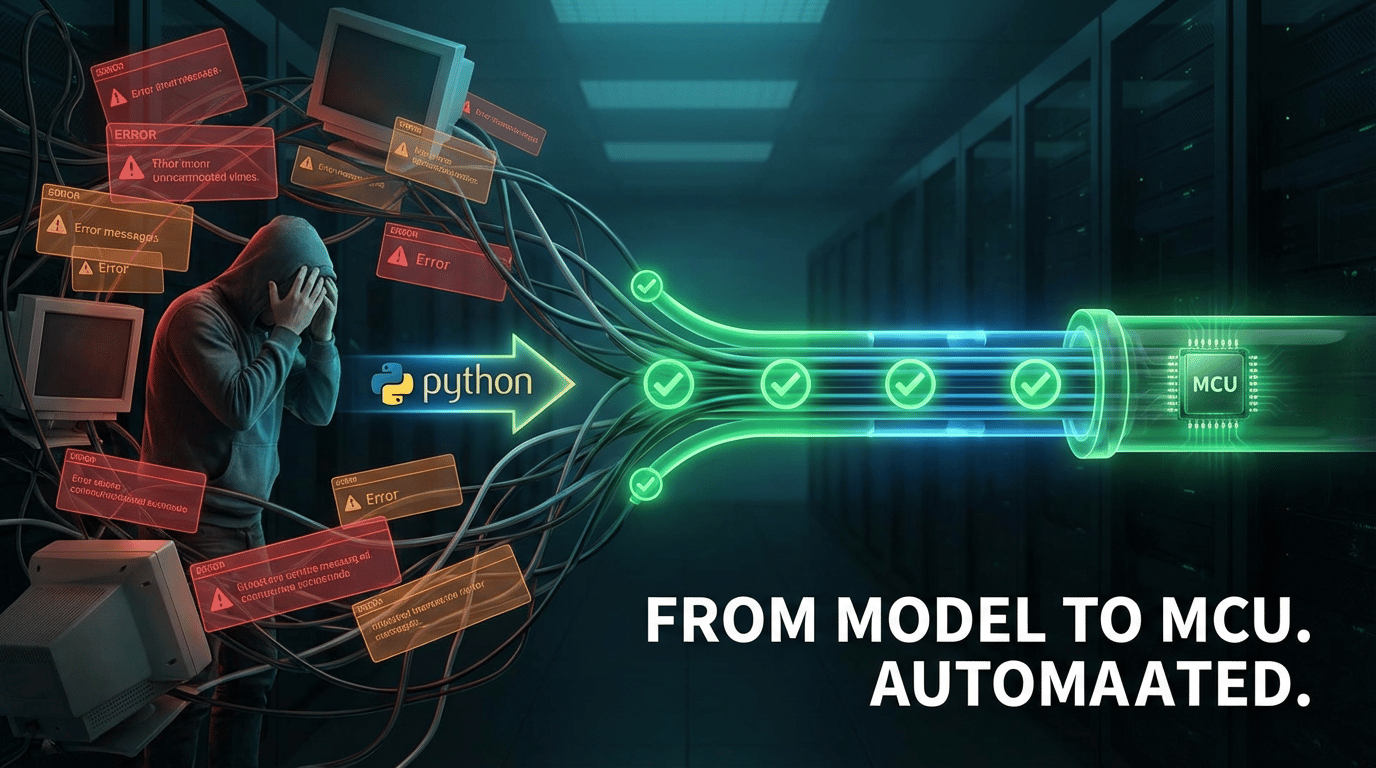

Demo 4 — AI 모델 올리는 고통이 줄어든다

이게 임베디드 개발자한테 제일 공감가는 데모예요.

AI 모델은 파이썬으로 만드는데, 그걸 MCU에 올리려면?

모델 변환 → 최적화 → 드라이버 연동 → 메모리 맞추기 → 디버깅 → 또 최적화...

이 과정이 몇 주씩 걸리는 게 현실이에요. AI 모델 성능이 아무리 좋아도, MCU에 올리는 작업만으로 프로젝트 일정이 터지는 경우가 허다해요.

Arm은 이번에 Keil MDK v6 + ExecuTorch + Zephyr 조합으로 이 파이프라인을 크게 줄였어요. 요리 비유로 하면, 파이썬으로 만든 레시피를 작은 MCU 주방에 맞게 자동으로 변환해주는 번역기가 생긴 거예요.

15년차 임베디드 개발자 시각에서 솔직하게

좋은 발표예요. 방향도 맞아요.

근데 현업에서 보면 몇 가지 현실적인 질문이 생겨요.

"MCU 메모리가 버텨줄까?" LLM을 MCU에 올린다는 게 아직은 매우 제한된 모델 크기 얘기예요. 실제 양산 제품에서 쓸 수 있는 수준까지 가려면 시간이 더 필요해요.

"개발 툴체인이 실제로 편해질까?" Demo 4가 보여준 자동화는 분명 좋은 방향인데, 실제 프로덕션 환경에서 얼마나 안정적으로 동작하느냐가 관건이에요.

"자동차 도메인은 언제?" 자동차는 AUTOSAR, ISO 26262 같은 안전 규격이 있어서 새 기술 도입이 훨씬 느려요. Edge AI가 양산 차량에 들어오려면 아직 넘어야 할 산이 많아요.

그럼에도 불구하고, 이번 Embedded World 2026에서 Arm이 보여준 방향은 분명해요.

임베디드 개발자가 지금 준비해야 할 것

- NPU 개념 이해: 어떤 연산을 NPU에 맡길 수 있는지 파악하기

- Edge AI 툴체인 경험: TensorFlow Lite, ExecuTorch 같은 온디바이스 배포 툴 익히기

- 온디바이스 모델 최적화: 양자화(Quantization), 프루닝(Pruning) 개념 공부

AI는 클라우드만의 이야기가 아니에요. MCU 개발자도 이제 AI를 알아야 하는 시대가 왔어요.

마무리

Arm 공식 발표 원문은 여기서 볼 수 있어요: 👉 Arm Newsroom — Embedded World 2026

이 글이 도움이 됐다면 공유해주세요. 임베디드 개발자 커뮤니티에 더 많은 분들이 이 흐름을 알았으면 좋겠어요.

댓글